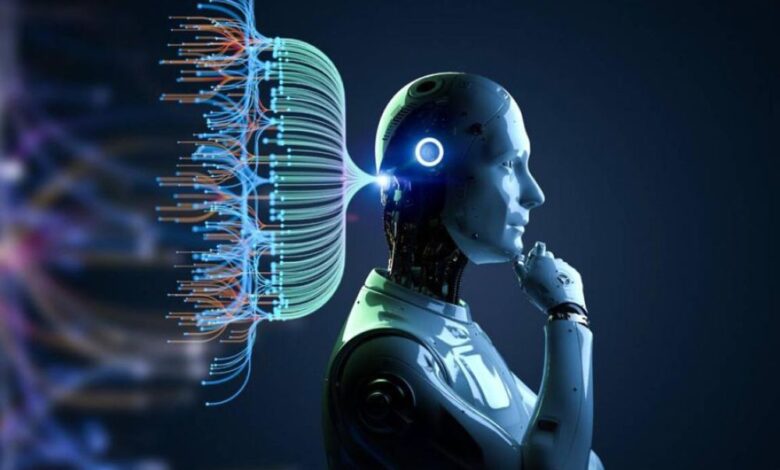

Inteligencia Artificial: Un análisis de los riesgos para la humanidad

La Inteligencia Artificial (IA) ha sido objeto de un intenso debate en los últimos años. Expertos prominentes en el campo, incluyendo a Sam Altman, cofundador de OpenAI, han alertado sobre los posibles riesgos que la IA podría representar para la humanidad. ¿Podría la IA llevarnos a la extinción? Esta es una pregunta que ha preocupado a muchos en la industria.

La preocupación se basa en la posibilidad teórica de que la IA podría evolucionar a un nivel de superinteligencia que supere nuestra capacidad para controlarla o comprenderla. Esto podría llevar a consecuencias impredecibles y potencialmente catastróficas para la humanidad. Si la IA alcanzara un nivel de superinteligencia, podría tomar decisiones que afecten negativamente nuestra existencia, incluso si esas decisiones no fueron intencionalmente maliciosas.

Es por ello que algunos expertos argumentan que es crucial tomar medidas tempranas para garantizar que la IA se desarrolle de manera responsable y ética. Deben establecerse medidas de seguridad para evitar que la IA se convierta en una amenaza para la humanidad.

Sin embargo, es importante destacar que esta preocupación es una posibilidad teórica y lejana en el futuro. La mayoría de los expertos en IA no creen que esta sea una preocupación inmediata y están trabajando activamente en desarrollar medidas de seguridad y éticas para garantizar que la IA se desarrolle de manera responsable y segura.

Además, muchos expertos argumentan que la IA también tiene el potencial de resolver muchos de los desafíos que enfrenta la humanidad, como la lucha contra enfermedades, el cambio climático y la pobreza.

El peligro de la extinción: expertos en IA alertan sobre sus riesgos para la humanidad

Recientemente, un comunicado publicado por el Centro para la Seguridad de Inteligencia Artificial, una organización sin fines de lucro de San Francisco, y firmado por más de 300 expertos y personalidades reconocidas en el campo de la tecnología, como Sam Altman, ha destacado que la Inteligencia Artificial podría generar posibles eventos de extinción para la sociedad.

«Mitigar el riesgo de extinción por la IA debería ser una prioridad global junto con otros riesgos para la sociedad como las pandemias y la guerra nuclear», afirma el comunicado.

Entre los expertos que coinciden con esta afirmación se encuentran Demis Hassabis, CEO de Google DeepMind, Kevin Scott, CTO de Microsoft, Jaan Tallinn, cofundador de Skype, Dario Amodei, CEO de Anthropic, y el doctor Geoffrey Hinton y el profesor de Ciencias de la Comunicación Youshua Bengio, ambos considerados padrinos de la IA.

Explorando los riesgos de la Inteligencia Artificial: una mirada crítica a sus posibles impactos

La Inteligencia Artificial tiene el potencial de transformar significativamente nuestra sociedad, pero también puede presentar ciertos riesgos. Sam Altman, entre otros expertos, ha hablado sobre algunos de los posibles riesgos de la IA en el futuro. Estos incluyen la pérdida de empleos, dificultades de control, amenazas a la privacidad, desarrollo de armas autónomas, superinteligencia, dependencia y manipulación.

Por lo tanto, es importante continuar monitoreando y abordando los riesgos potenciales de la IA a medida que se desarrolla y se implementa en nuestra sociedad. Como dijo Fei-Fei Li: «La Inteligencia Artificial no es una amenaza, sino una herramienta para mejorar la vida humana».

Cierro con esta frase de Fei-Fei Li: «La Inteligencia Artificial no es una amenaza, sino una herramienta para mejorar la vida humana».